日本のAI主権を強化し、研究開発能力を強化するために、日本産業技術総合研究所(AIST)は数千 Nvidia H200 Tensor Core GPUをAI Bridging Cloud Infrastructure 3.0スーパーコンピュータ(ABCI 3.0)に統合します。 Hewlett Packard Enterprise Cray XDシステムには、次の特徴があります。 Nvidia Quantum-2 優れたパフォーマンスとスケーラビリティのためのInfiniBandネットワーキング。

ABCI 3.0は、AI R&Dを開発するために設計された日本の大規模オープンAIコンピューティングインフラストラクチャの最新バージョンです。このコラボレーションは、日本のAI能力を発展させ、技術的独立性を強化する意志を強調しています。

AIST役員の吉尾田中氏は、「2018年8月に世界初の大規模オープンAIコンピューティングインフラインABCIを発売しました」と述べた。過去数年間、ABCIを管理した経験に基づいて、今度はABCI 3.0にアップグレードしています。 生成型AI 日本です。」

AIST Solutions Co.のプロデューサーであり、ABCI運営責任者である広高小川は、「生産的AIが世界的変化を促進する準備をするだけに、日本内で研究開発能力を迅速に育てることが重要です」と述べました。 「NVIDIAとHPEとの協力によるABCIのこの主要なアップグレードは、国内産業および学界におけるABCIのリーダーシップを強化し、日本をAI開発から世界的な競争力に導き、将来の革新の基盤になると確信しています」

ABCI 3.0:日本AI研究開発の新しい時代

ABCI 3.0は、AIST、その子会社であるAIST Solutions、およびシステムインテグレータHewlett Packard Enterprise(HPE)によって開発および運営されています。

ABCI 3.0プロジェクトは、経済見通しを通じてコンピューティングリソースを強化するための日本経済産業省(METI)の支援によるものであり、ABCI活動とクラウドAIコンピューティング投資の両方を含むMETIのより広範な10億ドル規模のイニシアチブの一部です。です。

NVIDIAは昨年、会社設立者兼CEOのジェンソンファンが日本を訪問し、岸田首相など政界および財界指導者に会い、AIの未来について議論した後、METIと研究・教育分野で緊密に協力しています。

日本の未来へのNVIDIAの献身

黄は特に、生成AI、ロボット工学、量子コンピューティング分野の研究に協力し、AIスタートアップに投資し、AIに対する製品サポート、教育および訓練を提供すると約束しました。

黄は、訪問中に最も計算集約的なAIタスクを処理するように設計された次世代データセンターである「AIファクトリー」が、膨大な量のデータをインテリジェントに変換するために不可欠であると強調しました。

黄首相は12月、日本メディアとの会合で「AI工場は全世界現代経済の基盤になるだろう」と話した。

超高密度データセンターとエネルギー効率の高い設計により、ABCIはAIとビッグデータアプリケーションを開発するための堅牢なインフラストラクチャを提供します。

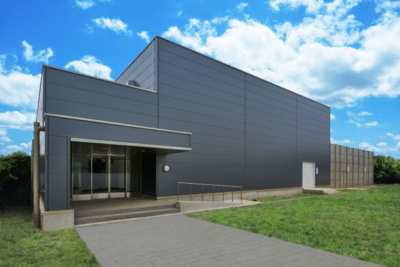

このシステムは今年末までにオンラインになる予定で、最先端のAI研究開発リソースを提供する予定です。東京近くの柏に位置する予定です。

比類のないコンピューティング性能と効率性

この施設では、以下を提供しています。

- 希少性なしでAI固有の性能を測定する6 AIエクサフロップのコンピューティング容量

- 410倍精度ペタフロップ、一般コンピューティング容量測定

- 各ノードは、200 GB / sの2分の帯域幅でQuantum-2 InfiniBandプラットフォームを介して接続されています。

NVIDIAテクノロジは、このイニシアチブの中枢を形成し、それぞれ8つのNVLlinkで接続されたH200 GPUを搭載した数百のノードは、前例のないコンピューティング性能と効率性を提供します。

NVIDIA H200は、毎秒4.8テラバイト(TB / s)の140ギガバイト(GB)以上のHBM3eメモリを提供する最初のGPUです。 H200のより大きく高速なメモリは、生成されたAIとLLMを加速するとともに、より良いエネルギー効率とより低い総所有コストでHPCワークロードのための科学的コンピューティングを発展させます。

NVIDIA H200 GPUは、LLMトークン生成などのAIワークロードの場合、前世代のABCIアーキテクチャよりもエネルギー効率が15倍高いです。

高度なNVIDIA Quantum-2 InfiniBandとネットワーク内コンピューティング(ネットワーキングデバイスがデータの計算を実行してCPUの作業負担を軽減)を統合すると、効率的で高速で低遅延通信が保証され、集約的なAIワークロードと膨大なデータセットを処理するために不可欠です。

ABCIは世界クラスのコンピューティングとデータ処理能力を誇り、産業、学界、政府との共同AI研究開発を加速するプラットフォームとして機能します。

METIの大幅な投資は、AIの開発能力を強化し、生産的なAIの使用を加速しようとする日本の戦略的ビジョンを実証しています。

日本はAIスーパーコンピュータ開発に補助金を支給することで、次世代AI技術開発にかかる時間とコストを削減し、グローバルAI分野のリーダーとして位置づけたいと考えています。

+ There are no comments

Add yours