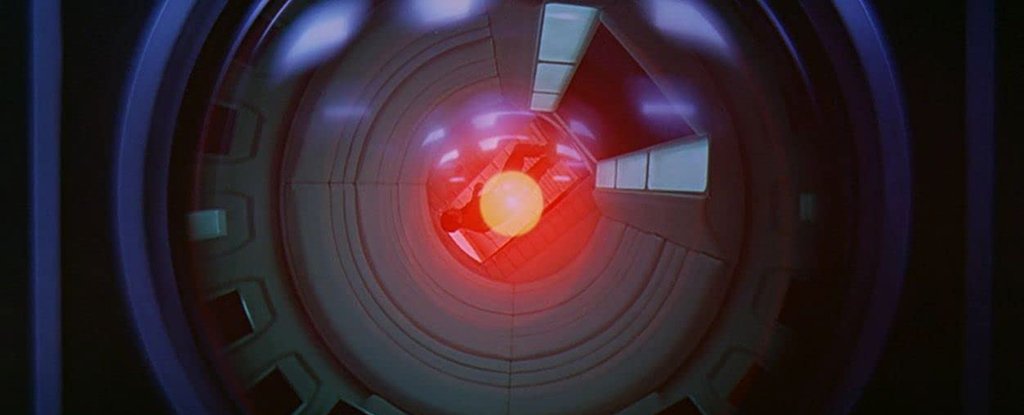

人類を転覆させる人工知能の考えは 数十年は、科学者たちは、私たちが、高レベルのコンピュータスーパーインテリジェンスを制御することができるかどうかの評決をだけ伝えました。 答え? ほぼ確実にありません。

問題は、人間の理解をはるかに超える超知能を制御するには、私たちが分析することができる超知能のシミュレーションが必要だということです。 しかし、我々はそれを理解することができない場合は、そのようなシミュレーションを作成することは不可能です。

「人間に害を及ぼさないない」のようなルールは、AIが作り上げるシナリオの種類を理解していなければ設定できない、新しい論文の著者は、提案します。 いったんコンピュータシステムプログラマの範囲を超えるレベルで動作する場合、それ以上の制限を設定することができません。

「超知能は「ロボット倫理」という旗印の下、一般的に研究されているものと根本的に異なる問題を提起します。」 研究を送る。

「これは超知能がなら的であるため、制御することができることは言うまでもありません人間に潜在的に理解できない目標を達成するために潜在的に、様々な資源を動員することができるからです。」

チームの推論の一部は、 中断の問題 問題は、コンピュータプログラムが結論と答えに到達するかどうか(ハング)または単に見つけるために永遠に繰り返すかどうかを知ることです。

Turingが一部を介して証明したように スマート数学は、いくつかの特定のプログラムの場合、作成することができるすべての潜在的なプログラムについて、これを知ることができる方法を見つけることは論理的に不可能です。 それは私たちを、人工知能に戻すの、超知能状態では、すべての可能なコンピュータプログラムをメモリに一度に保存することができます。

例えば、AIが人間に害を及ぼして、世界を破壊することを防ぐために作成されたすべてのプログラムは、結論に達した(中断)されることもありそうでない場合があります。 いずれにせよ、絶対に確信しているのは、数学的に不可能です。

「実際に、これは隔離アルゴリズムを使用することができなくなります。」 コンピュータ科学者Iyad Rahwanは、ドイツのMax-Planck人間開発研究所で。

AIに倫理を教え、世界を破壊しないように言っているよう(アルゴリズムは、絶対に確認することができないこと)を言う代わりに、超知性の能力を制限するものと研究者たちは言う。 たとえば、インターネットの一部または特定のネットワークでブロックされることがあります。

新しい研究は、このアイデアも拒否し 人工知能 – 議論は、私たちが人間の範囲を超えて問題を解決するためにそれを使用しない場合は、なぜそれを作成するのでしょうか?

私たちは、人工知能にこれから進んだならば、私たちが制御することができない超知能がいつ到着するかさえ知らないことがあります。 つまり、私たちが行く方向にいくつかの深刻な質問をする必要があります。

「世界を制御する超知能機械はサイエンスフィクションのように聞こえます。」 コンピュータ科学者Manuel Cebrianは言う、Max-Planck人間開発研究所で。 「しかし、プログラマがどのように学んだ、完全に理解していないまま重要なタスクを独立して実行する機械が既に存在します。」

「したがって、任意の時点で、これは人類に制御不可能で危険になる可能性かどうかの疑問が提起されます。 “

研究の結果は、 人工知能研究ジャーナル。

+ There are no comments

Add yours