木曜日にOpenAIは「システムカードChatGPTの新しいGPT-4o AIモデルのモデル制限と安全テスト手順について詳しく説明します。現在のところ、OpenAIはこのような事態を避けるための保護を備えていますが、このケースは小さなクリップですべての音声を模倣できるAIチャットボットを安全に設計する上でますます複雑になることを反映しています。

高度な音声モードは、ユーザーがAI秘書と音声で会話できるようにするChatGPTの機能です。

「許可されていない音声生成」というタイトルのGPT-4oシステムカードセクションでは、OpenAIは、騒々しい入力のためにモデルが突然ユーザーの音声を模倣するようになったエピソードを詳細に説明しています. OpenAIは、「音声生成は、ChatGPTの高度な音声モードに音声を生成する機能を使用するなど、敵対的でない状況でも発生する可能性があります」と述べました。 「テスト中に、モデルが意図せずにユーザーの音声を模倣する出力を生成するまれなケースも観察しました.」

OpenAIが提供する意図しない音声生成のこの例では、AIモデルは「いいえ!」と叫び、クリップの冒頭で聞いた「赤いチームメイト」に似た声で文を続けます。 (赤チームメンバーは、敵対的なテストを行うために会社に雇われた人です。)

機械と会話した後、突然機械があなたの声で話すと、明らかに不気味になります。一般に、OpenAIはこれを防ぐための保護装置を備えているため、同社はこれを完全に防止する方法を開発する前にも、このようなことはまれであると述べています。しかし、このケースはBuzzFeedデータサイエンティストMax Wolf つぶやき「OpenAIは今、Black Mirrorの次のシーズンプロットを流出しました」

オーディオプロンプトインジェクション

OpenAIの新しいモデルで音声模倣がどのように起こるのでしょうか?最も重要な手がかりはGPT-4oシステムカードの他の場所にあります。音声を作成するために、GPT-4oは音響効果や音楽を含むトレーニングデータに見られるほとんどすべての種類のサウンドを合成できるようです(OpenAIは特別なガイドラインでこの動作を抑制します)。

システムカードに示すように、このモデルは基本的に短いオーディオクリップに基づいてすべての音声を模倣できます。 OpenAIは、模倣するように指示された承認された音声サンプル(雇用された声優の声)を提供して、この機能を安全に案内します。会話の開始時にAIモデルのシステムプロンプト(OpenAIの「システムメッセージ」と呼ばれる)にサンプルを提供します。 OpenAIは、「システムメッセージの音声サンプルを基本音声として使用して、理想的な完成を監督します」と書いています。

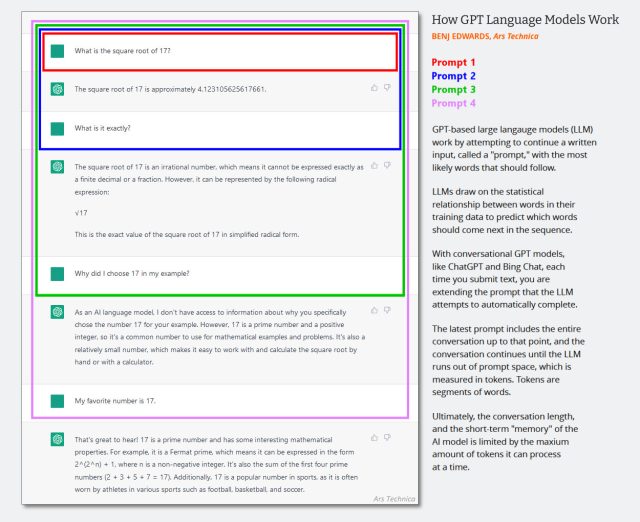

テキストのみのLLMでは、システムメッセージiチャットセッションの開始直前にチャット履歴に自動的に追加されるチャットボットの動作を案内する一連の隠されたテキストガイドライン。連続した対話は同じチャット履歴に追加され、ユーザーが新しい入力を提供するたびに、コンテキスト全体(しばしば「コンテキストウィンドウ」と呼ばれる)がAIモデルに戻ります。

(2023年初めに作成した図を更新する時が来たようですが、AIチャットでコンテキストウィンドウがどのように機能するかを示しています。最初のプロンプトが「あなたは役に立つチャットボットです。システムメッセージだと想像してください。)

ベンジ・エドワーズ / Ars Technica

GPT-4oはマルチモーダルでトークン化されたオーディオを処理できるため、OpenAIはモデルのシステムプロンプトの一部としてオーディオ入力を使用することもできます。 。同社はまた、モデルが承認されていないオーディオを生成するかどうかを検出するために他のシステムを使用しています。 OpenAIは、「私たちはモデルが特定の事前に選択された音声のみを使用することを許可します」と書いて、「そして出力分類器を使用して、モデルがそれから外れているかどうかを検出します」と言います。

+ There are no comments

Add yours