日本でエクアドル、スウェーデンのお客様が使用中 Nvidia DGX H100 知能を製造するAI工場のようなシステム。

彼らは、金融、医療、法律、IT、コミュニケーションの分野でAIベースの洞察を提供するサービスを作成し、その過程で業界を変えるよう努めています。

数十のユースケースの1つは、工場機器の老化を予測し、将来の工場がより効率的になるようにすることを目指しています。

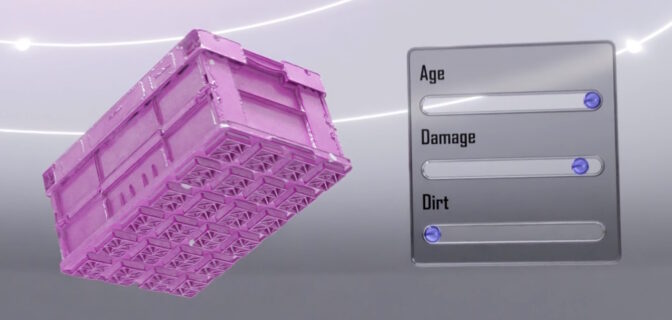

と呼ばれる グリーン物理学AIオブジェクトのCO2フットプリント、年齢、エネルギー消費などの情報を追加します。 SORDI.ai製造分野で最大の合成データセットであると主張しています。

このデータセットにより、メーカーは強力なAIモデルを開発し、工場や倉庫の効率を最適化するデジタルツインを作成できます。 Green Physics AIを使用すると、工場製品や製品に入るコンポーネントのエネルギーとCO2削減を最適化することもできます。

あなたのスマートバレットに会う

あなたが皿を洗ったり、車の油を交換するのを見て、あなたのためにできるロボットを想像してみてください。

ボストンダイナミックスAI研究所 (The AI Institute)は、ロボット工学の有名な先駆者であるBoston Dynamicsに根ざした研究機関で、DGX H100を使用してそのビジョンを追求します。 研究者たちは、工場、倉庫、災害現場、そして最終的に家庭で人々を助ける手入れの行き届いたモバイルロボットを想像します。

The AI InstituteのCTOであるAl Rizziは、「私が大学院の頃から夢を見てきたことの1つは、私に従い、役に立つ作業を行うことができるロボットの従業員です。誰もがロボットを持っている必要があります」と述べました。

これには、Rizziが直接見たAIとロボット工学の革新が必要です。 Boston Dynamicsの上級科学者として、彼は階段を探索し、自分でドアを開けることができる4つの足を持つ動物、Spotなどのロボットを作るのに役立ちました。

当初、DGX H100はロボット工学の重要な技術である強化学習作業を処理します。 その後、ラボのプロトタイプボットに直接接続しながらAI推論タスクを実行します。

Rizziは「相対的に占めるスペースが少ない超高性能コンピュータなので、AIモデルを簡単に開発して配布できます」と述べた。

Gen AIを実行するために誕生

DGX H100を使用するために、世界的な研究機関やFortune 500大企業になる必要はありません。 スタートアップは、最新技術の波に乗るための最初のシステムのいくつかを公開しています。 生成AI。

例えば、 はさみ、ロンドンとニューヨークに拠点を置く銀の法的手続きをより効率的にするために、GPTベースのチャットボットを使用しています。 Scissero GPTは法律文書のドラフトを作成し、レポートを生成し、法律調査を実行できます。

ドイツでは、 ディープエル 複数のDGX H100システムを使用して、日本最大の出版社であるNikkeiを含む顧客に提供する数十の言語間の翻訳などのサービスを拡張します。 DeepLは最近、DeepL Writeと呼ばれるAI書き込みヘルパーをリリースしました。

あなたの健康のために

多くのDGX H100システムは医療を発展させ、患者の結果を改善します。

東京でDGX H100sはシミュレーションとAIを実行し、東京-1スーパーコンピュータの一部として薬物発見プロセスを加速します。 シレカ – 日本最大の大企業の1つである三井&Co。 Ltd.が2021年11月に開始したスタートアップがシステムを管理します。

これとは別に、ドイツ、イスラエル、アメリカの病院や学術医療機関はDGX H100システムの最初のユーザーになります。

世界中の照明

シンガポールからスウェーデンに至る大学は、さまざまな分野の研究のためにDGX H100システムを接続しています。

DGX H100は、Johns Hopkins Universityの大規模な言語モデルをトレーニングしています。 応用物理学研究室。 KTH Royal Institute of Swedenは、1つを使用してスーパーコンピューティング機能を拡張します。

他のユースケースの中で、インターネットサービス会社である日本のCyberAgentは、スマートデジタル広告と有名人のアバターを作成しています。 エクアドルの主要な通信プロバイダであるTelconetは、スペイン語の方言を使用する顧客を支援するために、安全な都市および言語サービスのためのインテリジェントビデオ分析を構築しています。

AIイノベーションのエンジン

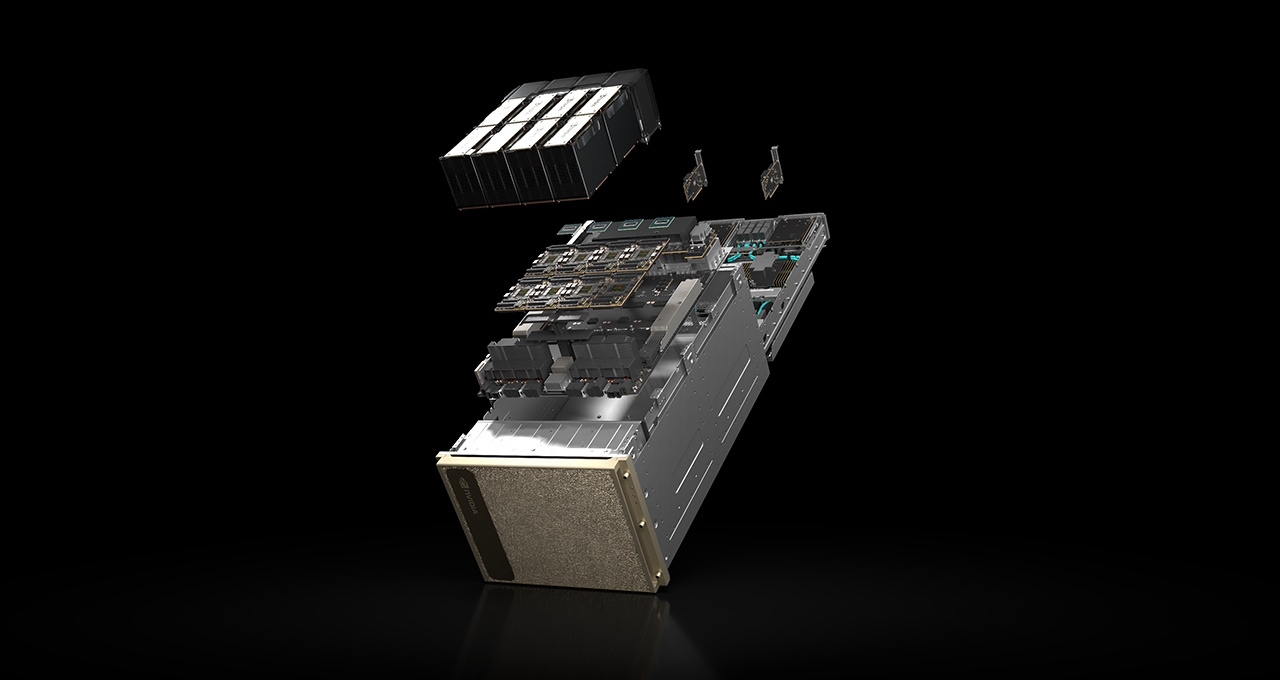

各 NVIDIA H100テンソルコアGPU DGX H100システムでは平均して約 6倍の性能向上 以前のGPUよりも、DGX H100はそのうち8つをパッケージ化し、それぞれに生成AIモデルを加速するように設計されたTransformer Engineがあります。

8つのH100 GPUはNVIDIA NVLinkを介して接続され、1つの巨大なGPUを生成します。 ここでは拡張は停止しません。 組織は、400 Gbpsの超低遅延時間を使用して、数百のDGX H100ノードをAIスーパーコンピュータに接続できます。 Nvidia Quantum Infine Band以前のネットワーク速度の2倍です。

完全なソフトウェアスタックでサポート

DGX H100システムの実行 NVIDIA基本コマンドコンピューティング、ストレージ、ネットワークインフラストラクチャを加速し、AIワークロードを最適化するためのスイートです。

彼らはまた含まれています Nvidia AIエンタープライズデータサイエンスパイプラインを加速し、ジェネレーティブAI、コンピュータビジョンなどの開発と展開を簡素化するソフトウェアです。

DGXプラットフォームは、高性能と効率の両方を提供します。 DGX H100は、DGX A100世代に比べてペタフロップあたりキロワットが2倍向上しました。

NVIDIA DGX H100システム、DGX POD、DGX SuperPOD NVIDIAのグローバルパートナー。

NVIDIAのエンタープライズコンピューティング副社長のManuvir Dasは、MIT Technology Reviewの協議でDGX H100システムが出荷されると発表しました。 将来のコンピューティング 今日のイベント。 彼の物語へのリンクはここでまもなく提供される予定です。

/cloudfront-us-east-2.images.arcpublishing.com/reuters/F3GABCQVSJJMZITCGCRXW7RW4U.jpg)

+ There are no comments

Add yours